阅读论文:Novel View Synthesis via Depth-guided Skip Connections

WACV2021,合成新视角(NVS)。

代码:https://github.com/AaltoVision/warped-skipconnection-nvs

问题:基于图像渲染(流预测):能使目标视角直接重用像素,但是容易产生扭曲的结果。像素生成方法:能生成结构一致的结果但是缺少低级细节。基于几何:计算成本昂贵。

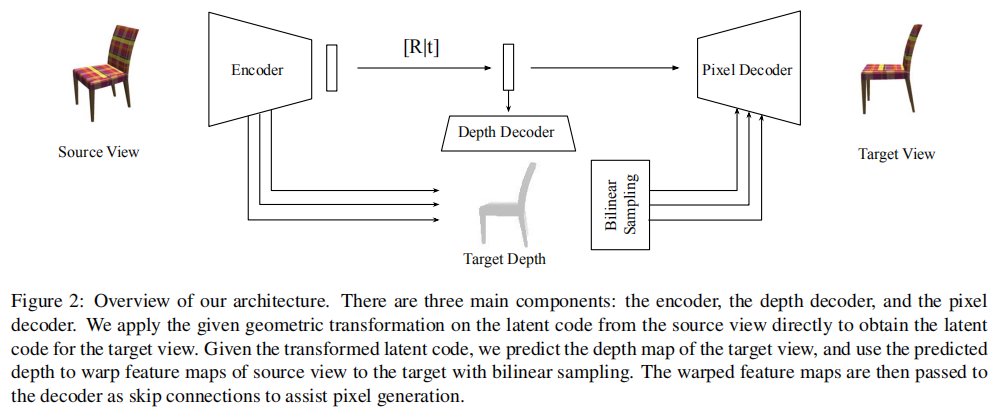

解决:利用编码器-解码器架构来回归目标视图的像素。将解码器对齐的特征图与跳过连接耦合,其中对齐由目标视图的预测深度图引导。

结构:编码器,深度预测解码器,像素生成解码器。

可转换的潜在代码:,,是的齐次表示。

深度引导的跳跃连接:

给定固有矩阵,相对的姿势,预测的目标视角深度图,能从源视图中找到对应关系。是目标视图和源视图中像素的齐次坐标。随后通过可微的双线性采样传到像素解码器。

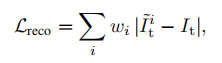

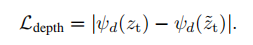

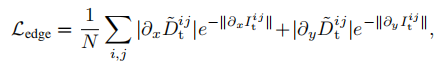

损失函数:对于像素回归,使用多尺度L1重构损失,VGG感知损失。以无监督的方法训练深度解码器,使用边缘感知平滑损失和深度一致性损失。

VGG感知损失:VGG16。

深度一致性损失:在没有监督的情况下规范潜在代码及其深度预测。

边缘感知平滑损失:鼓励预测的深度图在局部平滑。损失由一个边缘感知项加权,因为深度不连续经常发生在图像边缘。

数据集:ShapeNet,KITTI。

评估指标:L1,SSIM。

其他实验:消融实验,深度图估计。